ハローワールド、Hikaru Sanoです。

各社で開発が噂されているスマートグラス、噂自体は数年前からあるもののなかなかリリースされませんね。

スマートグラス開発の障害には様々あると思うのですが、操作に関して改善が見られそうな新しい技術が開発されたようです。

鼻を中心としたジェスチャー

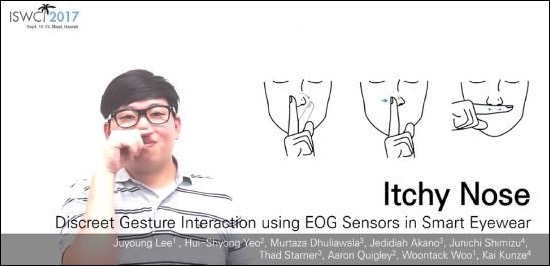

この度、日本の慶應義塾大学、アメリカのジョージア工科大学、韓国のKAIST大学、スコットランドのセントアンドリュース大学の共同開発で、スマートグラスの操作に関する新しい技術が国際シンポジウムで発表されました。

その新しい技術とは「Itchy Nose(直訳:かゆい鼻)」と呼ばれるもので、鼻を中心としたジェスチャーを認識する技術。

ジェスチャーは「Flicking」「Pushing」「Ribbing」の3種類で、「Flicking」は鼻をフリック、「Pushing」は鼻の片方を押す、「Ribbing」は鼻の下をこする、となっています。

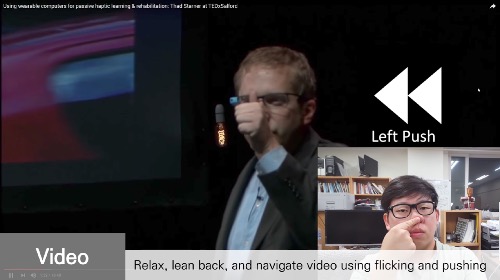

上記動画(約1分30秒)を見てもらえるとわかるのですが、スマホの機能を内臓したようなスマートグラスではなく、あくまでスマホを遠隔操作する装置としての技術の模様。

仕組みは割と単純で、メガネと鼻との接点になる「パッド」というパーツに振動などを感知するセンサーを内臓させ、鼻で行うジェスチャーの振動を検知するというもの。

動画ではスマホの着信を「Ribbing(こする)」で保留にしたり、ジェスチャーで音楽や動画を巻き戻したり早送りしたり、あるいは停止・再生したりしています。

スマホと一体になったような未来のデバイスではありませんが、スマホやPCを遠隔操作する機器としてはなかなか優秀に思えます。

ただ、動画の彼らが途中途中半笑いだった事でわかる通り、人前で操作するには恥ずかしいようにも思えます。

まとめ

とはいえ、ウェアラブルメガネを開発する上で鼻の振動が使えるようになるというのは、開発する側にとってかなり面白いアプローチになるでしょう。

操作の内容とセンサーの仕組み的に誤動作しそうな気もしますが、未来のウェアラブルデバイスに一歩近づいた気もしますね。